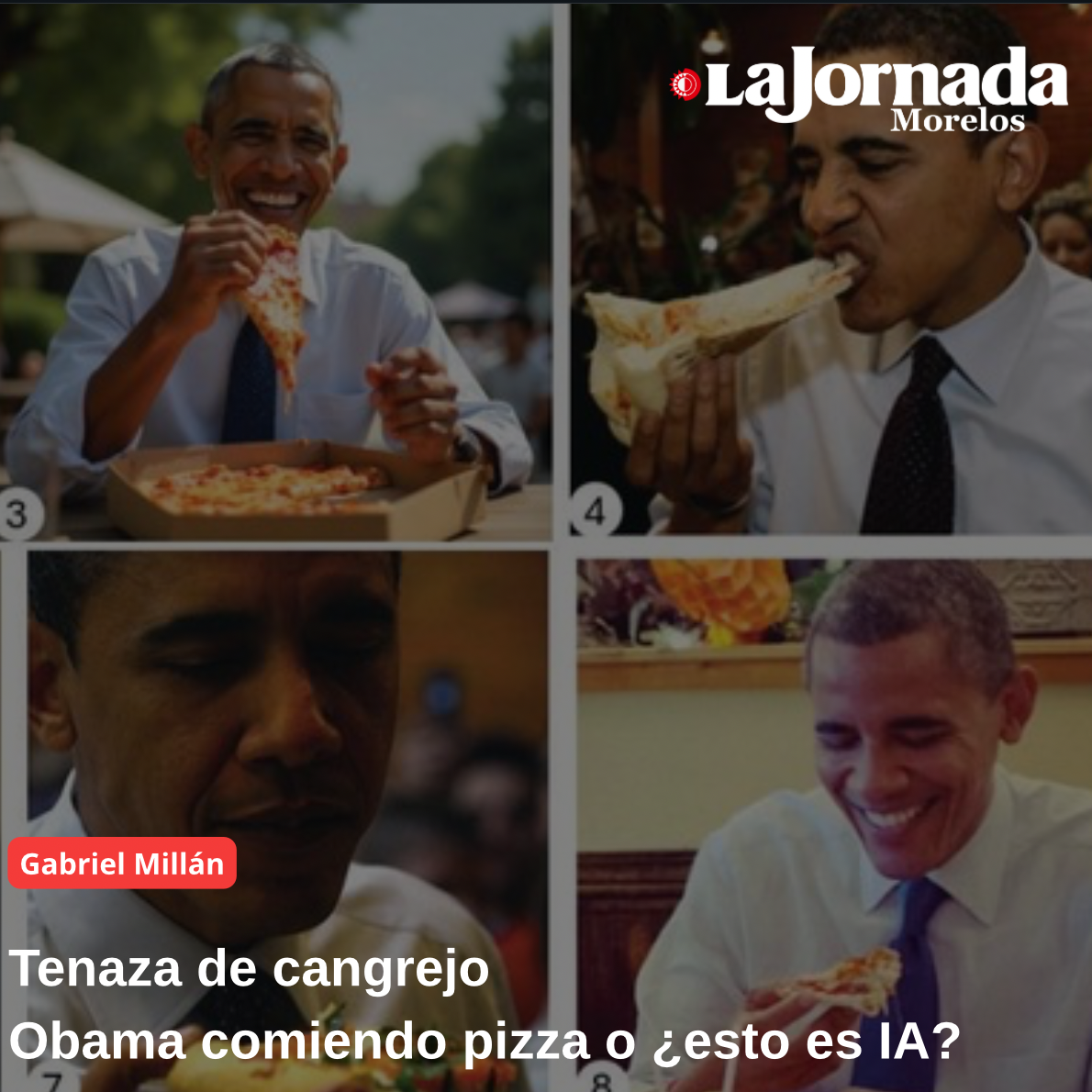

Obama comiendo pizza o ¿esto es IA?

Observe las imágenes que acompañan esta columna. Hágalo siguiendo la numeración del 1 al 8. ¿Listo? Dos de las imágenes son reales, 5 fueron generadas por Inteligencia Artificial (IA) y una es de origen dudoso, probablemente real pero editada#.

La imagen 1, que parece una escena de pesadilla, fue creada en junio de 2022 usando Dall-e mini, una aplicación para generar imágenes con IA. Dall-e fue uno de los primeros modelos con los que masivamente empezamos a crear imágenes a partir de texto, lanzado oficialmente en 2021 por OpenAI, la misma empresa del ahora omnipresente Chat GPT. Las imágenes que producía Dall-e mini, como puede verse, eran burdas, poco definidas y con muchísimos errores, una imagen a todas luces artificial.

Solo han transcurrido tres años y la IA pasó de esas escenas extrañas a imágenes y videos que, con honestidad, ya es muy difícil de identificar como “artificiales”. Sora 2 es el modelo más avanzado para generar videos de OpenAI (por el momento) y sus contenidos ya inundan Tiktok e Instagram; se dispersan por los WhatsApp y aparecen en los videos sugeridos de Facebook. Desde clips de animalitos “tiernos”, videos graciosos de interacciones humanas con gatos, osos, etc.; hombres y mujeres haciendo ejercicio o en la cima de un rascacielos, hasta reels de noticias que nunca existieron y presentadores que son IA.

Cuando pienso en los rápidos cambios que está teniendo la IA, de hacer garabatos a hiperrealismo, no puedo dejar de pensar en la película CHAPPiE, dirigida por Neill Blomkamp (el mismo de District 9 y Elysium). En la peli instalan un “algoritmo” de inteligencia artificial a un policía androide, el cual es robado por una pareja de gánsteres sin saber que es un robot con una red neural dentro que puede aprender, pasando de la inteligencia de un bebé hasta una persona adulta.

Cuando uno le pregunta a Chat GPT cómo funciona su modelo de entrenamiento explica, más o menos así:

El entrenamiento de los modelos grandes de inteligencia artificial tiene varias fases: 1) el preentrenamiento, donde el modelo se expone a enormes volúmenes de datos —libros, artículos, páginas web, código, imágenes y más— y aprende a predecir la siguiente palabra o token en un contexto dado, desarrollando así una comprensión estadística del lenguaje y del mundo. Esta fase requiere miles de unidades de procesamiento trabajando durante semanas, y una vez finalizada, el modelo posee una base general de conocimiento, pero todavía no está “alineado” con lo que los humanos consideran útil o seguro. 2) ajuste fino (fine-tuning), se entrena el modelo con datos más curados y específicos, supervisados por humanos que califican respuestas o ejemplos de comportamiento deseado; a menudo se emplea el método Reinforcement Learning from Human Feedback, donde el modelo aprende a preferir las respuestas mejor evaluadas por personas. 3) entrenamiento continuo o iterativo, que no es un aprendizaje en tiempo real, sino un reentrenamiento periódico con nuevos datos y correcciones, para mantener actualizados los modelos o lanzar versiones más avanzadas.

Es en la fase 2 del proceso de entrenamiento donde entran los data workers, trabajadores que etiqueta, clasifican y moderan grandes volúmenes de datos, entre textos, imágenes o videos, para entrenar y limpiar los modelos que luego producen resultados aparentemente automáticos. Esta tarea va desde identificar objetos en una imagen hasta filtrar contenidos violentos, sexuales o de odio antes de que sean usados en el entrenamiento. Este trabajo hecho por personas, sostiene la calidad y seguridad de los sistemas de IA; sin embargo, la mayoría de estos trabajadores no laboran directamente para las grandes compañías, sino que son subcontratados por otras empresas, generalmente en países pobres, con salarios bajos, poca protección laboral y exposición frecuente a materiales psicológicamente perturbadores.

Un ejemplo emblemático fue el caso de OpenAI en Kenia. Entre 2021 y 2022, la empresa subcontrató a la firma Sama para que trabajadores kenianos revisaran y etiquetaran textos extremadamente nocivos (violencia, abuso, pornografía infantil, tortura) con el fin de entrenar modelos más “seguros”, como ChatGPT. Los empleados, que ganaban entre 1.30 y 2 dólares por hora, denunciaron daños psicológicos severos y falta de apoyo emocional, además de una gran disparidad entre lo que OpenAI pagaba a Sama y lo que ellos recibían. Las condiciones llevaron a Sama a cancelar el contrato antes de tiempo y ni esta empresa ni OpenAI se hicieron responsables de los daños psicológicos que demandaban los trabajadores.

Volviendo a la generación de imágenes y videos, la capacidad de la IA para reproducir la realidad en archivos multimedia nos sitúa en un punto en el que, más que ser expertos en identificar qué es IA y qué no, debemos desarrollar una actitud mucho más crítica, menos crédula, frente a los contenidos que consumimos. Deberíamos tomar siempre con cautela ese reel, esa imagen que vimos en Facebook, o el video que nos enviaron por WhatsApp, y antes que asumir su veracidad, pensar que todo puede ser IA hasta que se demuestre lo contrario.

#Imágenes por IA: 1,2,3,5,6. Imágenes reales: 4,7. Imagen dudosa: 8

*Comunicador de ciencia / Instagram: @Cacturante